La inteligencia artificial (IA) está redefiniendo cómo trabajamos, aprendemos y tomamos decisiones. Sin embargo, su avance plantea un desafío crucial: la ética.

Hoy, más que preguntarnos qué puede hacer la IA, debemos cuestionarnos qué debe hacer y bajo qué principios de gobernanza, transparencia y rendición de cuentas.

En un mundo cada vez más impulsado por la IA generativa (Gen IA), la confianza pública depende de que las empresas y gobiernos adopten un enfoque responsable que respete la privacidad, la protección de datos, la equidad y la no discriminación.

¿Qué entendemos por ética en la IA?

La ética en la inteligencia artificial se refiere al conjunto de principios y valores que orientan el diseño, desarrollo y uso de los sistemas de IA para garantizar que sus decisiones sean justas, seguras y respetuosas con los derechos humanos.

Aplicar la ética implica incorporar equidad, no discriminación, mitigación de sesgos y transparencia en todo el ciclo de vida de la IA. Esto significa no solo diseñar algoritmos imparciales, sino también garantizar que las personas puedan comprender cómo y por qué se toman ciertas decisiones automatizadas.

La rendición de cuentas es otro pilar fundamental: toda decisión automatizada debe tener un responsable humano con la autoridad para revisar, corregir o detener procesos que puedan causar daño.

Confianza y percepción pública de la IA

Según los últimos estudios, el 65% de las organizaciones ya aplican marcos regulatorios como el Reglamento General de Protección de Datos (GDPR) y un 41% se rigen por la Ley Europea de IA (AI Act) para regular la ética de la IA (2025 AI Index report).

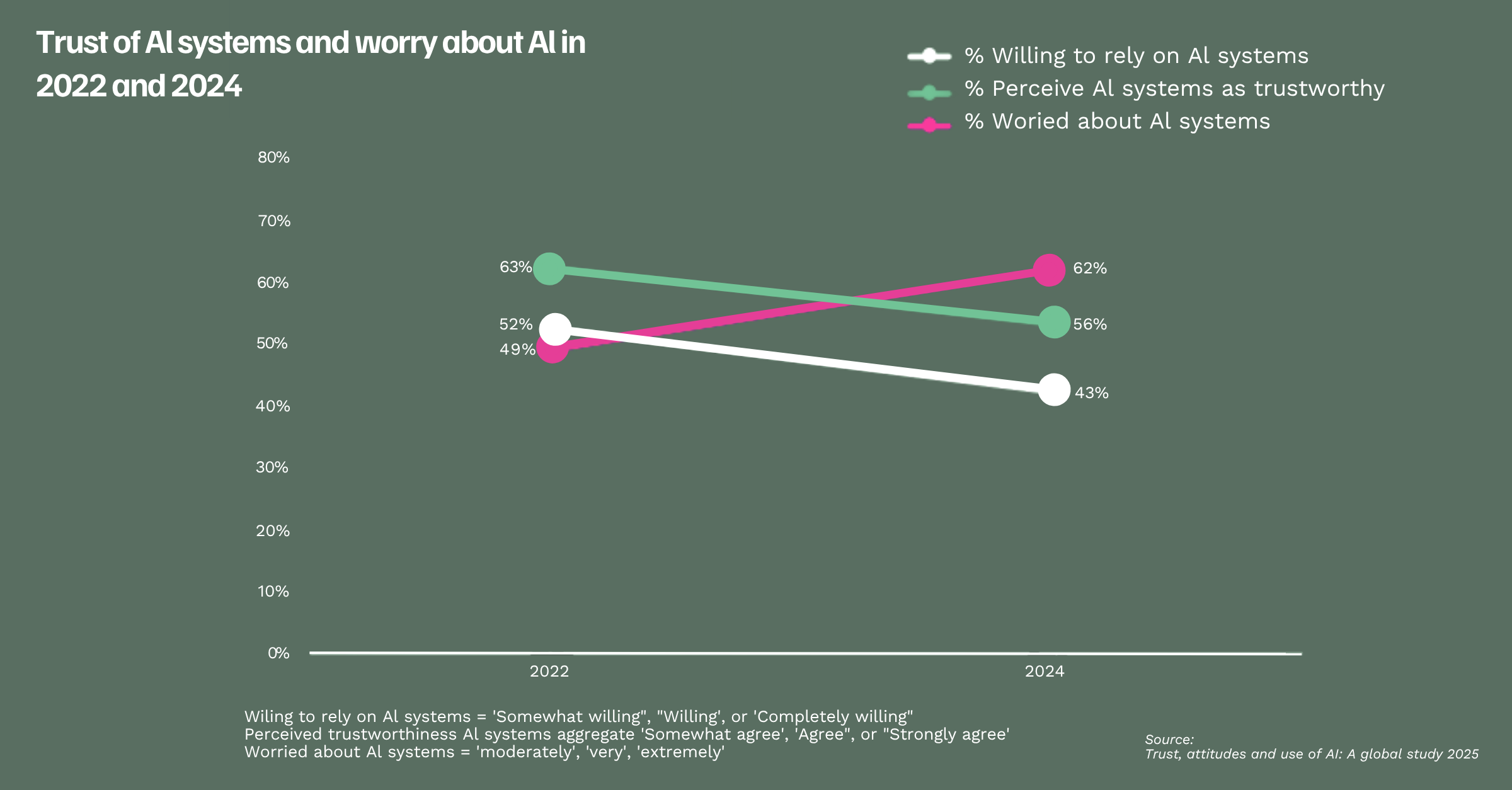

Aun así, la confianza social en los sistemas de IA ha disminuido de forma notable:

-

La disposición a confiar y depender de sistemas de IA cayó del 52% en 2022 al 43% en 2024,

-

La percepción de confiabilidad bajó del 63% en 2022 al 56% en 2024,

-

Mientras que la preocupación por el uso de la IA aumentó del 49% en 2022 al 62% en 2024.

(Trust, attitudes and use of AI: A global study 2025).

Estos datos reflejan un cambio profundo en la opinión pública: a medida que la IA se vuelve más poderosa, también crece la exigencia de transparencia, rendición de cuentas y supervisión ética.

La confianza ya no se gana solo con innovación, sino con gobernanza responsable, mitigación de riesgos y principios éticos claros.

¿Por qué la ética y el uso responsable de la IA son importantes?

La ética y la transparencia son esenciales para el uso responsable de la IA. Los algoritmos pueden influir en decisiones que afectan vidas humanas: contratación, crédito, salud o justicia.

Sin una adecuada gobernanza, la IA puede generar sesgos y discriminación, comprometer la privacidad o vulnerar el derecho al olvido de los usuarios.

Las organizaciones que aplican políticas éticas robustas ganan confianza, reputación y sostenibilidad, mientras que las que ignoran estos principios se exponen a riesgos legales, sociales y reputacionales.

Entre los retos más comunes destacan:

-

Falta de mitigación de sesgos en los datos de entrenamiento.

-

Escasez de marcos de gobernanza y monitoreo ético estandarizados.

-

Ausencia de políticas claras sobre protección de datos y privacidad.

-

Dificultades para medir el consumo energético y la huella ambiental de los modelos de Gen IA

En un entorno donde la IA generativa crea textos, imágenes o videos indistinguibles de los humanos, el riesgo de alucinaciones (información falsa o inventada) y de manipulación informativa exige una vigilancia constante.

El reto de la IA no ética

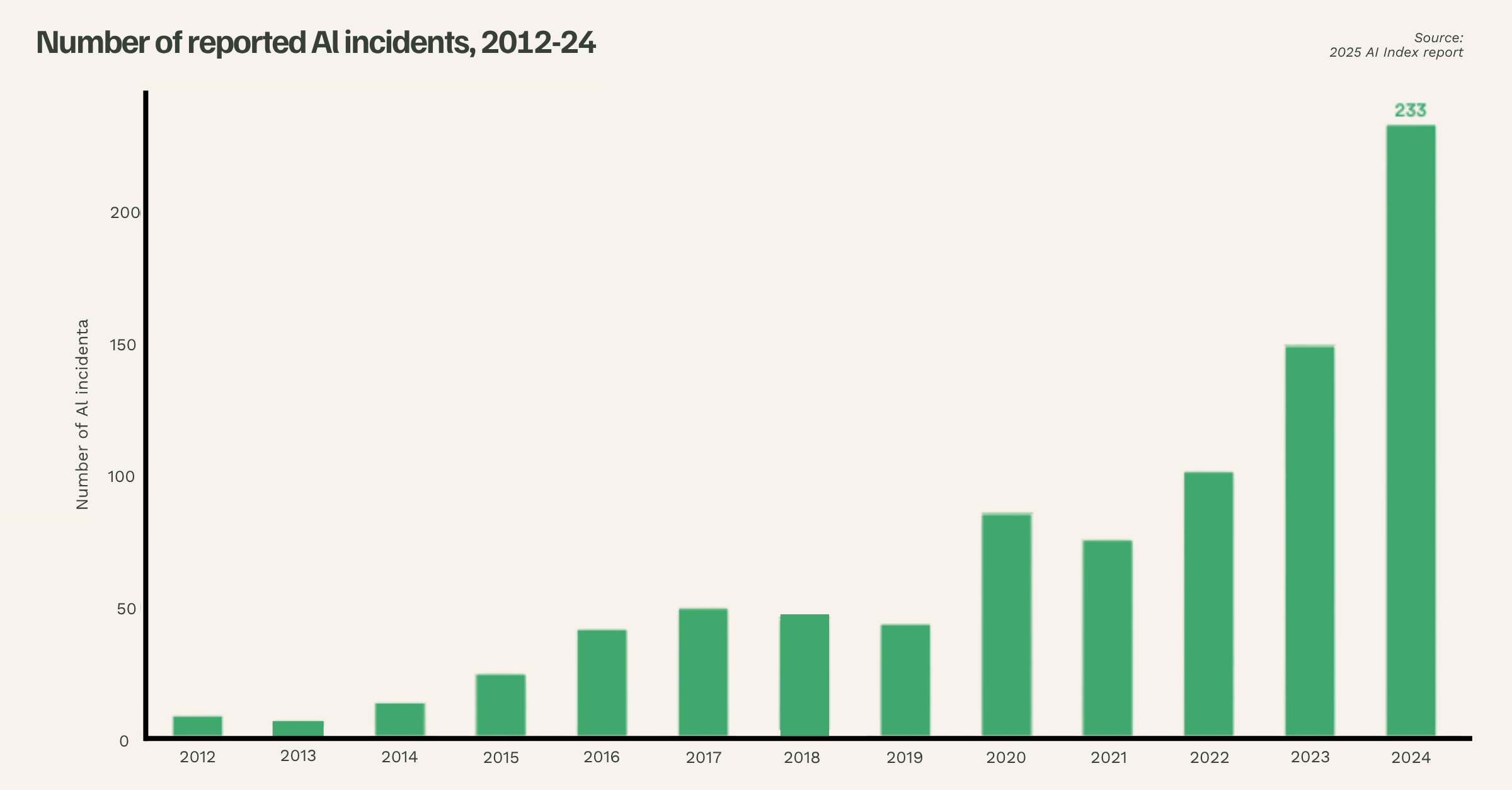

En 2024 se registraron 233 incidentes de mal uso de IA, el doble que en 2022 (2025 AI Index report).

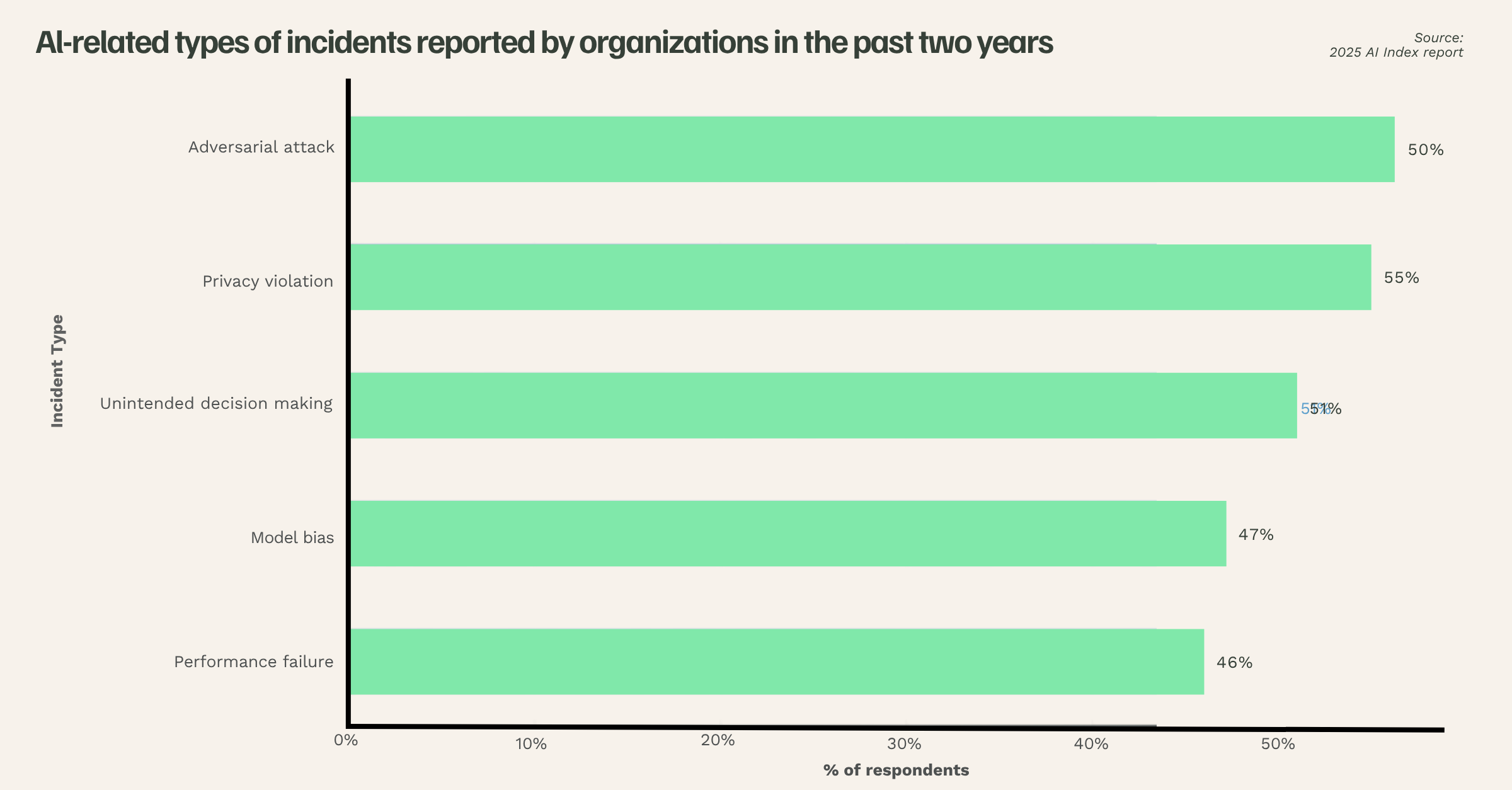

Los principales problemas fueron los ataques adversarios (56%), las violaciones de privacidad (55%) y las decisiones automatizadas no intencionadas (51%) (2025 AI Index report).

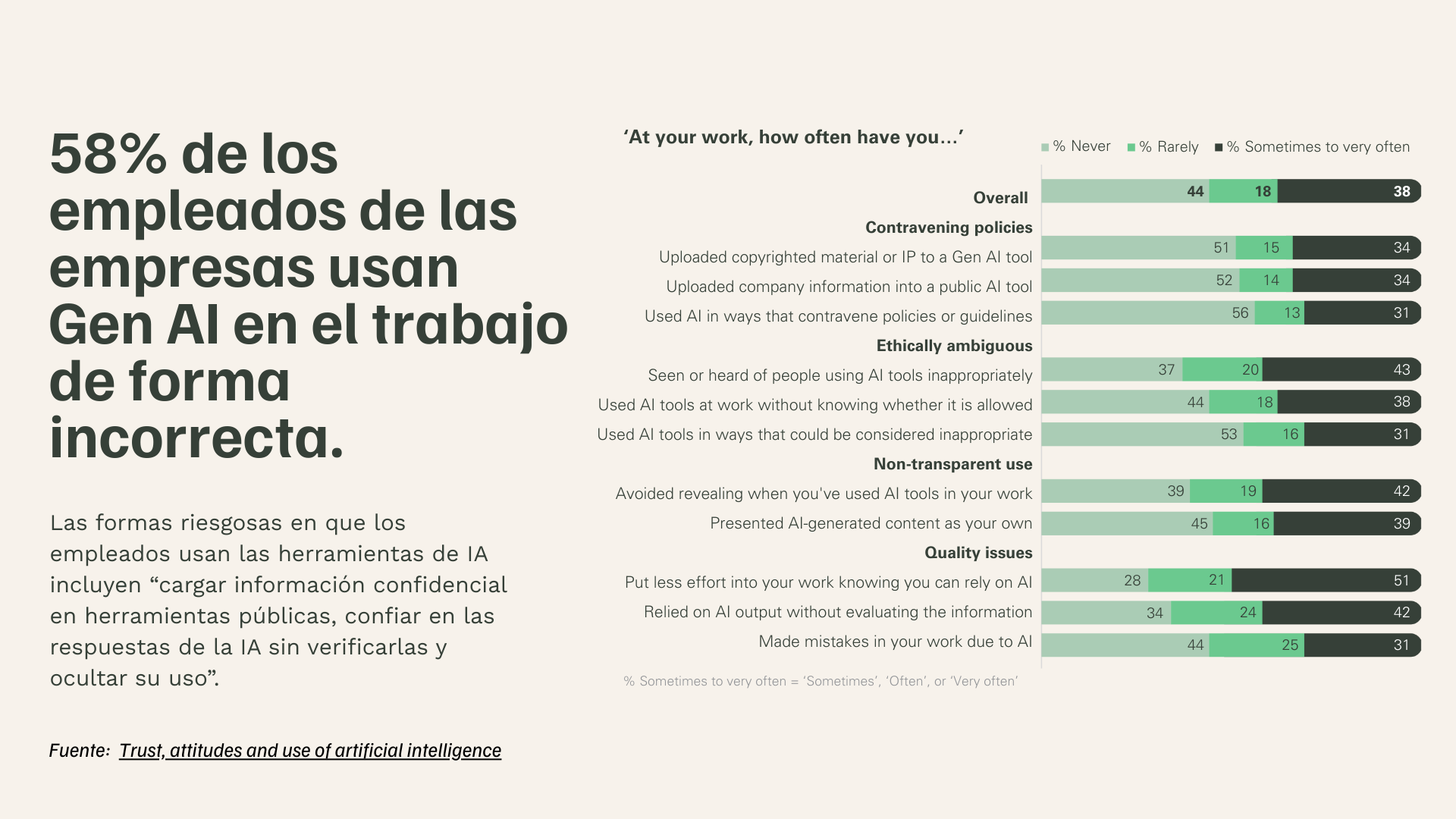

El 58% de los empleados reconocen haber usado herramientas de Gen IA en el trabajo sin autorización, y más de la mitad admiten haberlo hecho sin transparencia. Esta opacidad complica el monitoreo, la gobernanza y la rendición de cuentas en las organizaciones.

Casos reales: cuando fallan la ética y la transparencia

-

Reconocimiento facial y sesgos (Reino Unido, 2024): una mujer fue acusada erróneamente de robo por un sistema de reconocimiento facial, evidenciando la falta de equidad y mitigación de sesgos en tecnologías biométricas.

-

Deepfakes y acoso digital (EE. UU., 2024): una adolescente fue víctima de imágenes íntimas falsas generadas por IA generativa, revelando vacíos en la protección de datos y el derecho al olvido.

-

Chatbots y salud mental: un caso de suicidio adolescente vinculado a un chatbot demostró la ausencia de principios éticos, monitoreo continuo y rendición de cuentas en el diseño de IA conversacionales.

-

Desinformación electoral con Gen IA: campañas de “spamouflage” usaron contenidos generados artificialmente para manipular votantes, poniendo en riesgo la transparencia democrática.

(2025 AI Index report)

Estos casos muestran que los errores de la IA no son técnicos, sino éticos. Su impacto humano exige sistemas con controles de gobernanza, mitigación y auditoría constantes.

Principios para una IA ética y responsable

La UNESCO y los estándares internacionales como la ISO 42001 (Sistema de Gestión de Inteligencia Artificial) ofrecen marcos sólidos para garantizar la responsabilidad y seguridad en el desarrollo de IA.

Los principios éticos clave son:

-

Transparencia: explicar de forma clara cómo funciona la IA y con qué datos.

-

Proporcionalidad e inocuidad: evitar daños y garantizar un uso legítimo.

-

Seguridad y protección: mitigar riesgos y prevenir abusos.

-

Equidad y no discriminación: eliminar sesgos y asegurar decisiones justas.

-

Privacidad y protección de datos: aplicar “privacidad por diseño”.

-

Supervisión humana: toda decisión crítica debe tener control humano.

-

Rendición de cuentas (Accountability): definir responsables y auditorías.

-

Mitigación de sesgos y alucinaciones: control previo y monitoreo continuo.

-

Gobernanza colaborativa: integrar a expertos, usuarios y reguladores.

-

Sostenibilidad y consumo energético responsable: medir y reducir el impacto ambiental de los modelos de Gen IA.

Estos principios de ética y gobernanza deben aplicarse a lo largo de todo el ciclo de vida del sistema: desde el diseño hasta la monitorización posterior a su despliegue.

Beneficios de aplicar ética, gobernanza y monitoreo en la IA

Las empresas que incorporan la ética en sus estrategias de IA logran ventajas tangibles:

-

Mayor confianza de los clientes (34%).

-

Mejor eficiencia operativa (42%).

-

Cumplimiento normativo (GDPR, ISO 42001, AI Act).

-

Reducción de riesgos de sesgos, discriminación y alucinaciones.

(2025 AI Index report)

Además, las organizaciones que adoptan políticas de gobernanza y monitoreo continuo pueden detectar errores, corregir desviaciones y garantizar una IA segura y sostenible. Sin embargo, ningún marco ético o estándar —por sólido que sea— puede sostenerse sin un liderazgo comprometido.

La verdadera diferencia no la marcan los algoritmos ni las certificaciones, sino las personas que los dirigen. Aquí es donde entra en juego el liderazgo.

Liderazgo responsable: donde empieza la ética

La ética en la IA no se impone, se lidera.

Los equipos directivos deben promover una cultura basada en la transparencia, la responsabilidad y la rendición de cuentas, fomentando la educación ética en todos los niveles.

Liderar con ética significa cambiar las preguntas:

No “¿podemos automatizar esto?”, sino “¿deberíamos hacerlo?”. Y si la respuesta es sí, entonces preguntar “¿cómo garantizamos que sea justo, seguro y explicable?”.

La ética debe integrarse en la estrategia corporativa, no como una obligación legal, sino como una ventaja competitiva y un compromiso con el futuro.

Masterclass: Impact, Risks & Ethics in the era of AI

La inteligencia artificial puede impulsar el progreso o amplificar las desigualdades. El futuro de la IA no dependerá solo de la potencia de los modelos de Gen IA, sino de nuestra capacidad para aplicar ética, transparencia, rendición de cuentas, gobernanza y mitigación de sesgos en cada decisión que tomemos.

¿Quieres dar el siguiente paso y liderar el cambio hacia una IA más responsable?

Participa en la Masterclass “Impact, Risks & Ethics in the Era of AI” y aprende a aplicar las mejores prácticas de IA generativa responsable en tu organización o en tus propios proyectos como profesional independiente.

📆 5 Noviembre 2025

💻 Online, en vivo

👉 Inscríbete y obtén tu certificado internacional en Ética y Gobernanza de la IA: Masterclass: Impact, Risks & Ethics in the era of AI.

Convierte la innovación en un motor de confianza, sostenibilidad y propósito.