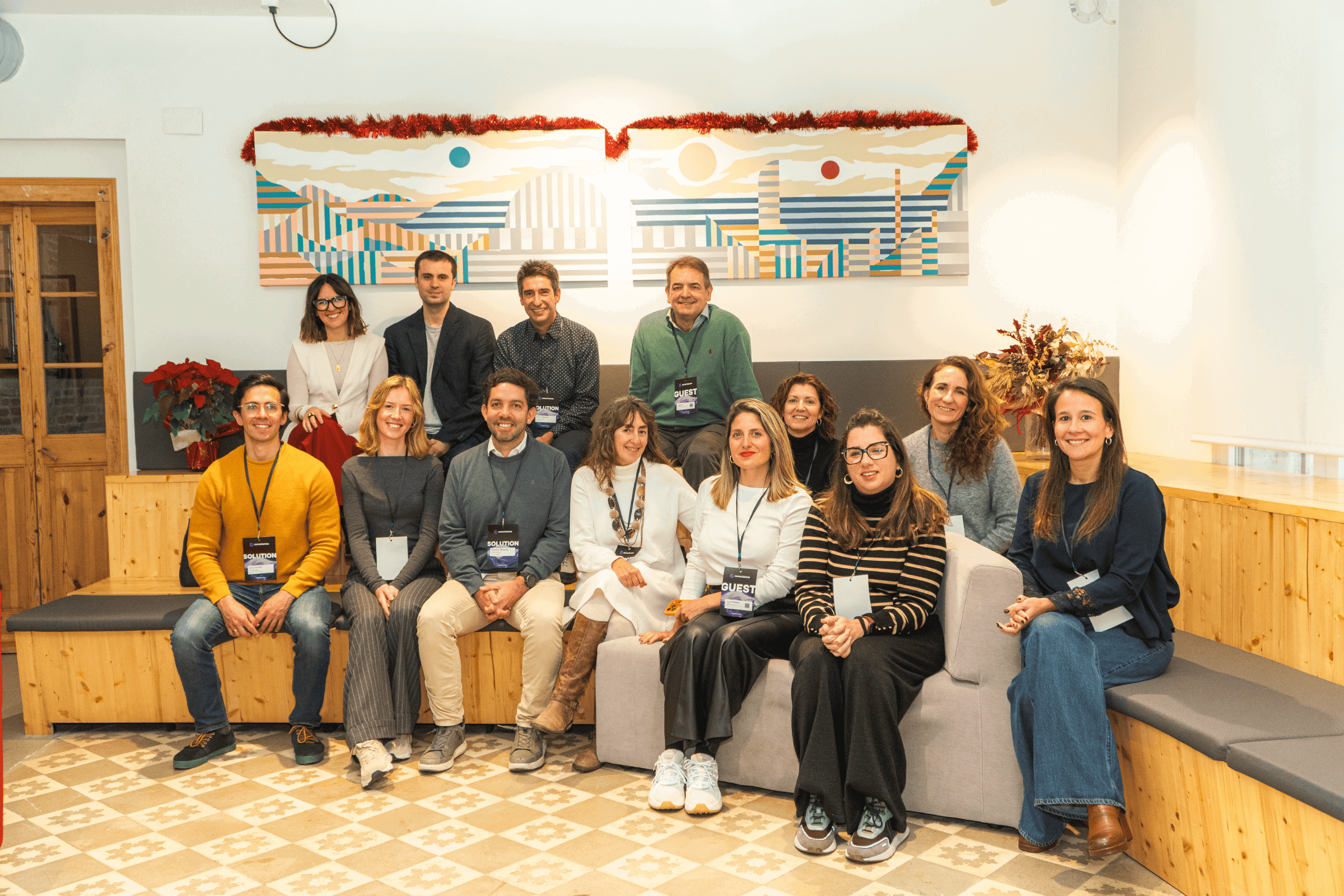

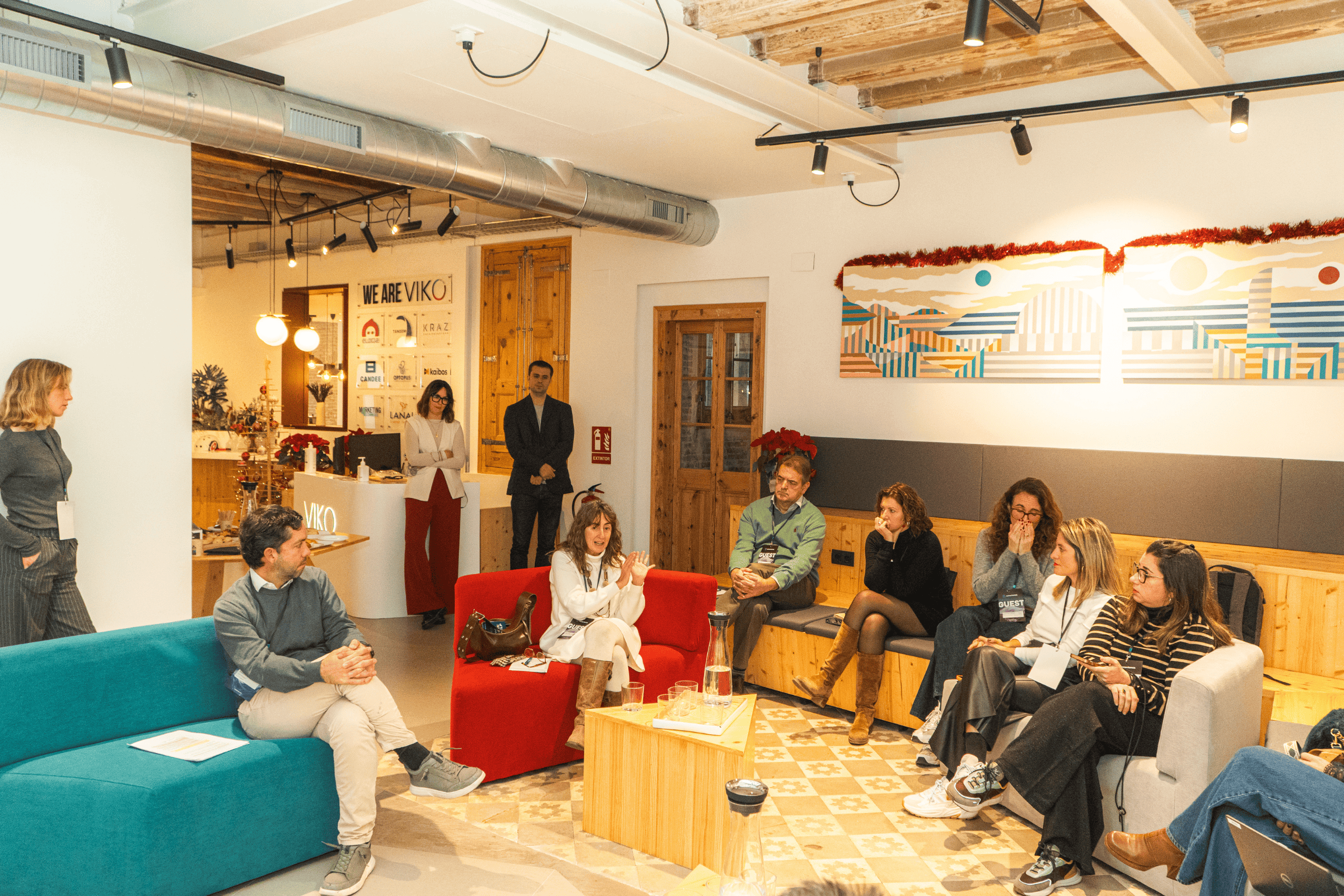

La adopción de la inteligencia artificial en las organizaciones avanza a gran velocidad, pero también conlleva riesgos significativos que no pueden pasarse por alto. En nuestra reciente Talk Session sobre IA Responsable con Conectamos, reunimos a un grupo de expertos en Recursos Humanos y Talento de 10 empresas líderes en España para analizar:

-

Los mayores desafíos del uso de la IA en las organizaciones.

-

El rol estratégico de Talento frente a los riesgos de adopción.

-

Las competencias clave necesarias para garantizar una implementación ética y segura.

Riesgos Principales del Uso de IA en las Organizaciones

Durante la sesión, identificamos varios riesgos que pueden afectar tanto a las personas como a la organización:

-

Pérdida de confianza y seguridad psicológica: los empleados pueden sentirse inseguros o desprotegidos frente a decisiones automatizadas.

-

Deterioro de las relaciones humanas y la cultura organizacional: la delegación excesiva a la IA puede afectar la interacción y colaboración entre equipos.

-

Sesgos y discriminación algorítmica: las decisiones automatizadas pueden reproducir desigualdades y generar impactos negativos en personas.

-

Delegación irresponsable: cuando confiamos demasiado en la IA, la responsabilidad humana se diluye.

-

Privacidad y uso abusivo de datos: el manejo inadecuado de información personal puede generar riesgos legales y reputacionales.

Como señaló un participante durante el debate:

“Esto me genera cierta incomodidad. No termino de confiar en la respuesta de esta persona porque no siento que sea genuina.”

Principios y Guías para una IA Responsable

La IA es una herramienta poderosa, pero no sustituye la preparación, el juicio y la responsabilidad humanas. Tener acceso a la tecnología no garantiza que sepamos cómo usarla correctamente en situaciones críticas. La metáfora de Simon Sinek resume bien esta realidad:

“Es como decir que la IA proporcionará barcos para todos, excepto en el momento de la tormenta, y entonces no sabrás nadar…”

Simon Sinek

Para mitigar estos riesgos, repasamos los principios y frameworks prácticos que toda organización debería considerar:

-

Agencia humana y supervisión: mantener la intervención y decisión humanas en procesos críticos.

-

Robustez técnica y seguridad: garantizar que los sistemas sean fiables y resistentes.

-

Privacidad y gobernanza de datos: proteger la información sensible y cumplir regulaciones.

-

Transparencia y explicabilidad: poder explicar cómo y por qué la IA toma decisiones.

-

Diversidad, no discriminación y equidad: asegurar que los sistemas sean justos y representativos.

-

Bienestar social y ambiental: evaluar el impacto de la IA en la sociedad y el entorno.

-

Responsabilidad: establecer mecanismos claros de rendición de cuentas.

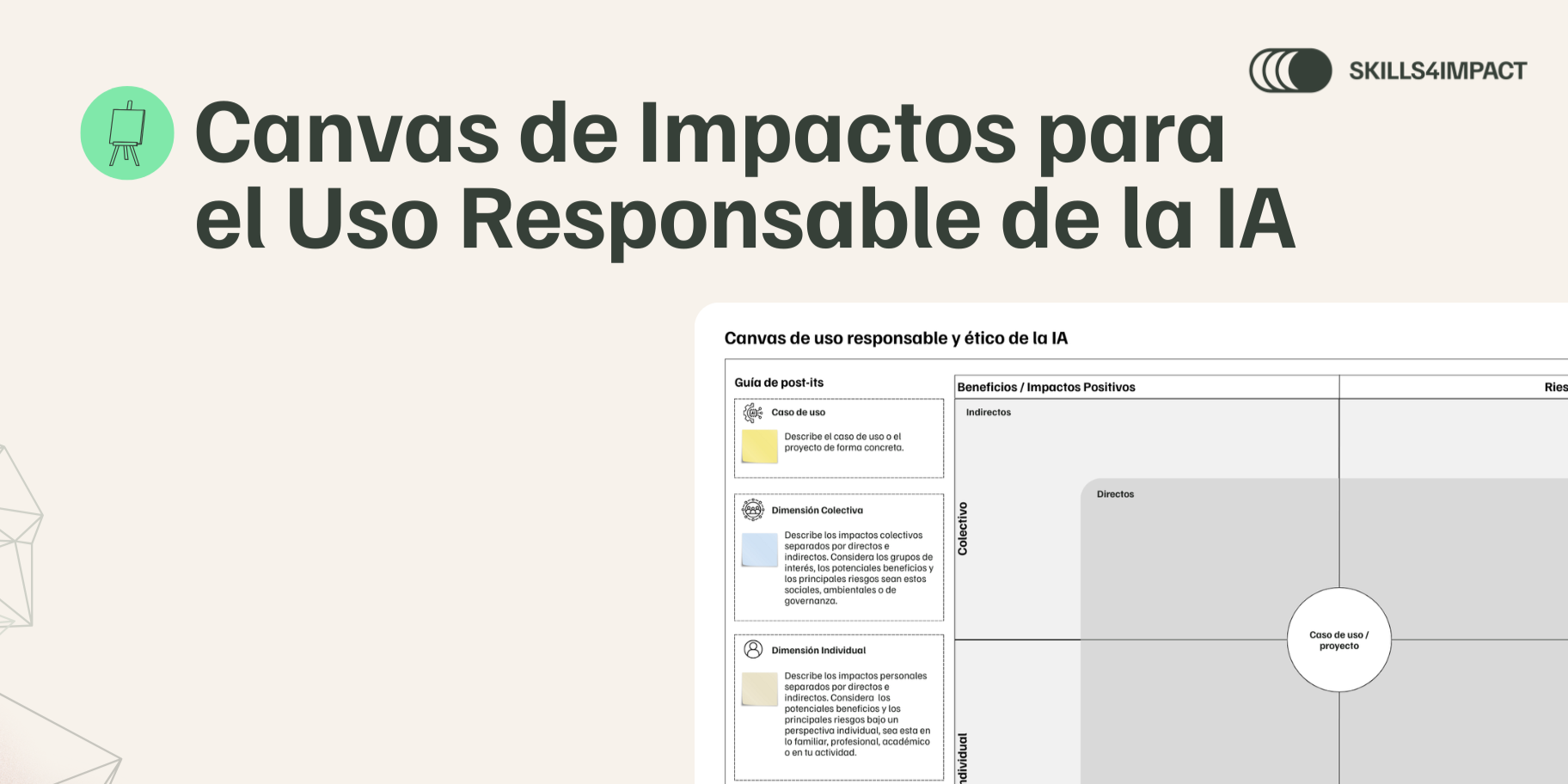

Para apoyar la implementación de estos principios, Skills4Impact propone el Canvas de Impactos para el Uso Responsable de la IA Generativa, una guía práctica para trabajar de forma individual o en equipos. La herramienta permite identificar impactos positivos y negativos a nivel individual y colectivo, considerando efectos directos e indirectos.

El Canvas incluye cuatro componentes: Caso de Uso, Dimensión Colectiva, Dimensión Individual y Punto de Reflexión, que facilitan la evaluación crítica y el contraste con valores y prioridades del equipo.

Contáctenos para acceder al Canvas de Impactos para el Uso Responsable de la IA aquí.

Rol Clave de Talento y Desarrollo de Competencias

El área de Talento juega un papel fundamental para garantizar y promover el uso responsable de la IA. Identificamos las competencias críticas a desarrollar:

-

Conocimiento y formación continua: la falta de educación sobre IA responsable es el principal obstáculo para su implementación.

-

Evaluación y supervisión de outputs de IA: asegurar que las decisiones automáticas sean revisadas y comprendidas.

-

Sensibilización sobre sesgos y ética: fomentar una cultura de conciencia sobre los riesgos y la equidad.

Un caso de éxito compartido fue el uso de Microlearning de Skills4Impact, que permite sensibilizar y capacitar a los empleados en el uso responsable de la IA de manera práctica y efectiva.

Descubre más sobre el Microlearning aquí.

Otros casos incluyen la creación de comités de IA por parte de los expertos invitados, e incluso comités de IA Responsable, lo que demuestra que la adopción ética de la IA ya se está consolidando como una prioridad estratégica para las empresas, y que los roles relacionados con IA y ética en IA están creciendo rápidamente.

Debate y Participación

La sesión incluyó un debate interactivo, con preguntas dirigidas a los participantes sobre cómo enfrentan los riesgos de la IA en sus organizaciones. La interacción permitió compartir experiencias, dudas y mejores prácticas, reforzando la idea de que la adopción responsable de la IA es un esfuerzo colectivo y transversal.

Algunos puntos claves del debate incluyen:

-

La clave no está en saberlo todo, sino en usar la IA de manera responsable, supervisando, combinando adecuadamente y tomando decisiones con criterio.

-

La IA puede mezclar ideas de terceros sin reconocer derechos, por lo que es necesario garantizar la atribución y la trazabilidad para evitar plagio o violaciones de licencias.

-

La IA puede dar respuestas plausibles, pero es imprescindible verificar cómo se aplicaron en la práctica y mantener supervisión humana en la evaluación de sus outputs.

Forma a tu Equipo en IA Responsable con Skills4Impact

La IA Responsable no es solo una cuestión tecnológica: es una competencia estratégica para 2026. Para aprovechar sus beneficios sin comprometer la confianza, la equidad y la cultura organizacional, las empresas deben:

-

Desarrollar competencias críticas en su talento.

-

Aplicar principios claros y guías prácticas.

-

Promover formación continua sobre ética y responsabilidad.

En definitiva, la clave no está solo en usar la IA, sino en saber usarla de manera responsable, combinando supervisión, criterio y conciencia ética.

Impulsa la adopción ética y segura de la IA en tu organización con nuestras soluciones de formación:

-

On-Site Bootcamps: Capacita a tu equipo de liderazgo con sesiones prácticas guiadas por expertos, explorando riesgos y oportunidades de la IA responsable.

-

Microlearning: Programas breves, enfocados y con alta tasa de finalización (80%), diseñados para que tus colaboradores apliquen lo aprendido de inmediato en su trabajo diario.

Prepara a tu equipo para tomar decisiones informadas, supervisar la IA con criterio y garantizar un uso responsable que impulse tu negocio.

Únete a nuestra próxima Talk Session con Conectamos

Buscamos a responsables de Talento y Recursos Humanos para unirse a nuestro próximo evento sobre IA Responsable.

Durante la sesión, exploraremos los desafíos, riesgos y competencias clave para una adopción ética y segura de la IA en las organizaciones.

Si estás interesado/a en asistir, contáctanos en: info@skills4impact.org